Sind KI-Wasserzeichen ethisch? Die Datenschutzdebatte um versteckte Textmarker

Erkunden Sie die ethischen Implikationen von KI-Wasserzeichen in ChatGPT und anderen KI-Modellen. Verstehen Sie die Datenschutzbedenken, rechtlichen Perspektiven und die Debatte um Benutzerkontrolle über KI-generierte Inhalte.

Einführung

Jedes Mal, wenn Sie ChatGPT, Claude oder Googles Gemini verwenden, generieren Sie nicht nur Text – Sie werden möglicherweise verfolgt. Versteckt in Ihren KI-generierten Inhalten befinden sich unsichtbare Wasserzeichen, winzige digitale Fingerabdrücke, die den Text als maschinenGeneriert identifizieren. Aber hier ist die ethische Frage, die hitzige Debatten in Tech-Communitys, akademischen Institutionen und Datenschutzgruppen auslöst:

Ist es ethisch, dass KI-Unternehmen versteckte Marker in Ihren Text einbetten, ohne ausdrückliche Zustimmung? Und noch wichtiger, sollten Sie das Recht haben, sie zu entfernen?

Dies ist nicht nur ein technisches Problem – es ist eine fundamentale Frage über digitalen Datenschutz, Benutzerautonomie und das Gleichgewicht zwischen Transparenz und Überwachung im Zeitalter der KI. Da KI tief in unsere täglichen Arbeitsabläufe integriert wird, hat sich die Ethik unsichtbarer Wasserzeichen als eine der umstrittensten Debatten in der heutigen Technologie herausgestellt.

In dieser umfassenden Untersuchung werden wir beide Seiten der KI-Wasserzeichen-Debatte prüfen, die Datenschutzimplikationen analysieren, rechtliche Perspektiven betrachten und Ihnen helfen, Ihre Rechte und Optionen in Bezug auf KI-generierte Inhalte zu verstehen.

Was sind KI-Wasserzeichen?

Bevor wir in die ethische Debatte eintauchen, lassen Sie uns klären, worüber wir tatsächlich diskutieren.

KI-Wasserzeichen sind unsichtbare Marker, die in Text eingebettet sind, der von KI-Sprachmodellen wie ChatGPT, Claude und Gemini generiert wird. Diese Marker nehmen typischerweise die Form an von:

- Zero-Width-Zeichen (unsichtbare Unicode-Zeichen wie U+200B, U+200C, U+200D)

- Statistischen Mustern (subtile Verzerrungen in Wortwahl und Token-Auswahl)

- Semantischen Fingerabdrücken (charakteristische Muster in Satzstruktur und Formulierung)

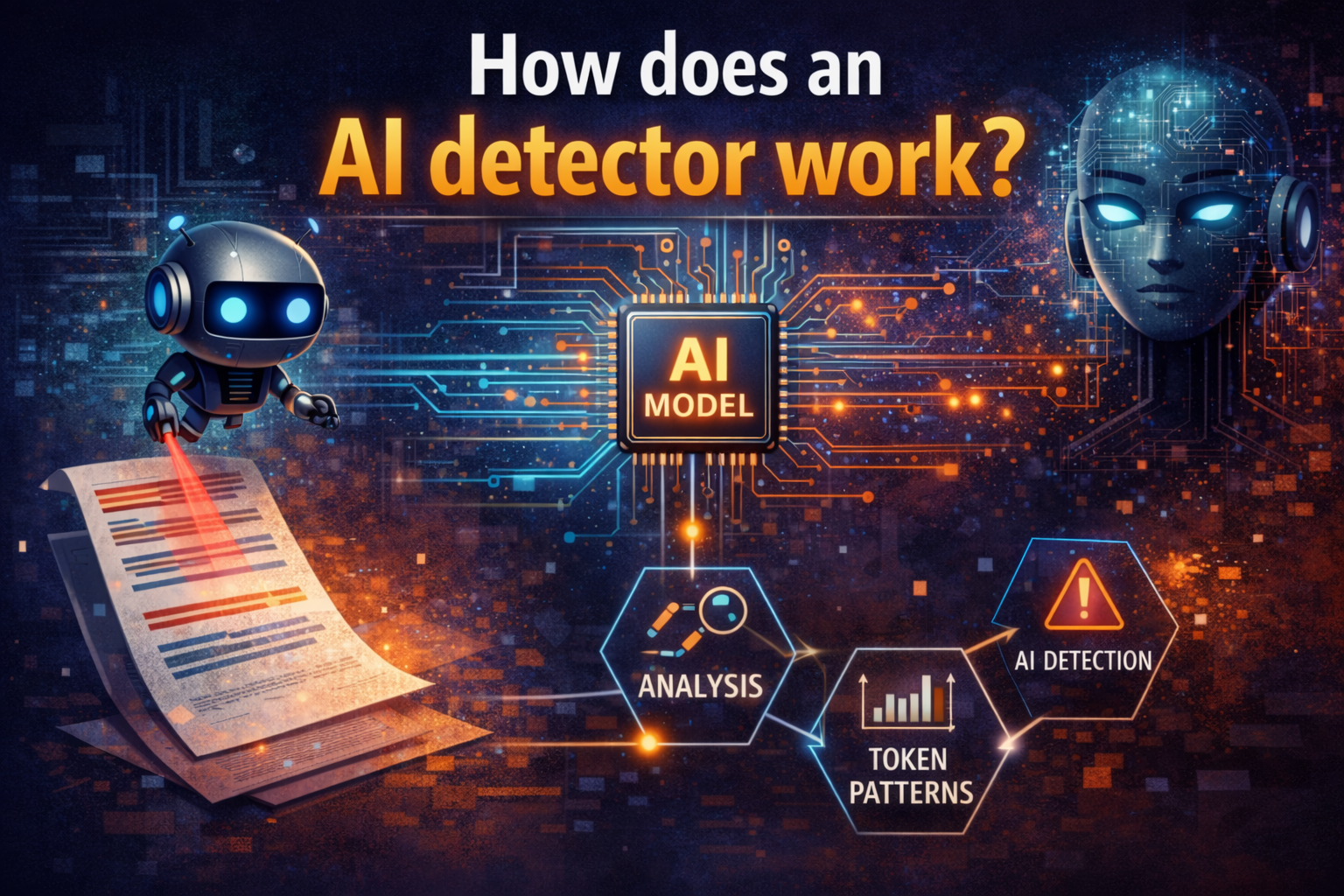

Wie KI-Wasserzeichen funktionieren

Wenn ein KI-Modell Text generiert, kann es diese Marker an verschiedenen Stellen einfügen:

Original-Text: "Der schnelle braune Fuchs springt über den faulen Hund"

Mit Wasserzeichen: "Der schnelle braune Fuchs springt über den faulen Hund"

↑ ↑ ↑ ↑ ↑ ↑ ↑ ↑

(unsichtbare Zero-Width-Zeichen eingebettet)

Sie können sie nicht sehen, aber sie sind da – und sie können offenbaren:

- Welches KI-Modell den Text generiert hat

- Wann er generiert wurde

- Möglicherweise welches Benutzerkonto ihn erstellt hat

- Die während der Generierung verwendeten Parameter

Das Datenschutzproblem mit KI-Wasserzeichen

Hier entsteht die ethische Komplexität. Was als Transparenzmechanismus begann, hat sich zu etwas entwickelt, das ernsthafte Datenschutzbedenken aufwirft:

1. Unsichtbare Verfolgung ohne Zustimmung

Die grundlegende Datenschutzverletzung ist einfach: Benutzer werden nicht ausdrücklich darüber informiert, dass Wasserzeichen hinzugefügt werden.

Wenn Sie ChatGPT verwenden, werden Sie dies in den Nutzungsbedingungen sehen:

"Wir können verschiedene Techniken verwenden, um von unseren Modellen generierten Inhalt zu identifizieren."

Aber diese vage Sprache stellt keine informierte Zustimmung dar, weil:

- ❌ Sie in langen Nutzungsbedingungen vergraben ist, die die meisten Benutzer nie lesen

- ❌ Sie die spezifischen verwendeten Wasserzeichen-Methoden nicht erklärt

- ❌ Sie nicht klarstellt, welche Daten eingebettet werden

- ❌ Benutzer können nicht ablehnen und dennoch den Dienst nutzen

Die ethische Frage: Ist es akzeptabel, Benutzer ohne ihre ausdrückliche, informierte Zustimmung zu verfolgen?

Die ausgeglichene Perspektive: Können Datenschutz und Transparenz koexistieren?

Die KI-Wasserzeichen-Debatte muss nicht ein Nullsummenspiel sein. Hier ist, wie wir sowohl Transparenz als auch Datenschutz erreichen können:

1. Opt-In-Wasserzeichen

Lösung: Wasserzeichen zu einer Benutzerentscheidung machen, nicht zu einem versteckten Standard.

Implementierung:

[✓] Wasserzeichen hinzufügen, um dies als KI-generierten Inhalt zu kennzeichnen

Dies hilft anderen, KI-Unterstützung zu erkennen und unterstützt

Transparenz. Sie können es jederzeit entfernen.

[ ] Kein Wasserzeichen – sauberen Text generieren

Vorteile:

- ✅ Benutzer, die Transparenz wollen, können Wasserzeichen wählen

- ✅ Benutzer, die Datenschutz brauchen, können ablehnen

- ✅ Entspricht informierten Zustimmungsprinzipien

- ✅ Respektiert Benutzerautonomie

2. Sichtbare, nicht unsichtbare Marker

Lösung: Unsichtbare Wasserzeichen durch sichtbare, benutzerkontrollierte Offenlegung ersetzen.

Beispiel-Implementierung:

---

Generiert mit: ChatGPT (GPT-4)

Datum: 16. Januar 2025

Benutzeroffenlegung: "KI-unterstützte Forschungszusammenfassung"

---

[Ihr Inhalt hier]

Vorteile:

- ✅ Vollständige Transparenz

- ✅ Keine versteckte Verfolgung

- ✅ Benutzer können Fußzeile bei Bedarf entfernen

- ✅ Klare, ehrliche Offenlegung

3. Client-seitige Wasserzeichen-Erkennung

Lösung: Benutzern Tools zur lokalen Erkennung und Entfernung von Wasserzeichen bereitstellen.

Das ist genau, was GPT Watermark Remover tut:

- 🔒 Client-seitige Verarbeitung — Ihr Text verlässt niemals Ihr Gerät

- 🔍 Transparente Erkennung — zeigt Ihnen, welche Wasserzeichen existieren

- 🧹 Benutzerkontrolle — Sie entscheiden, ob Sie sie entfernen

- 📄 Formaterhaltung — behält Dokumentstruktur bei

GPT Watermark Remover testen →

Fazit: Transparenz und Datenschutz können koexistieren – wenn Benutzer Kontrolle haben

Die Ethik von KI-Wasserzeichen ist nicht schwarz-weiß. Beide Seiten haben legitime Bedenken:

Transparenz-Befürworter haben recht, dass die Gesellschaft davon profitiert, zu wissen, wann Inhalte KI-generiert sind.

Datenschutz-Befürworter haben recht, dass unsichtbare Verfolgung ohne Zustimmung eine fundamentale Verletzung der Benutzerrechte ist.

Die Lösung besteht nicht darin, das eine über das andere zu wählen – sondern Benutzer mit Kontrolle zu befähigen.

Der ausgeglichene Ansatz

Woran wir glauben:

-

Transparenz sollte sichtbar sein, nicht versteckt Unsichtbare Verfolgung durch klare, benutzerkontrollierte Offenlegung ersetzen.

-

Datenschutz ist ein Recht, kein Privileg Benutzer sollten kontrollieren, welche Metadaten bei ihren Inhalten bleiben.

-

Benutzerautonomie ist wichtig Menschen Tools geben und ihnen vertrauen, ethische Entscheidungen zu treffen.

-

Ethik wird nicht durch Wasserzeichen bestimmt Ehrlichkeit und Absicht sind wichtiger als unsichtbare Marker.

-

Technologie sollte Benutzern dienen, sie nicht überwachen KI sollte Kreativität befähigen, nicht Unternehmens-Tracking ermöglichen.

"Transparenz und Datenschutz können koexistieren – wenn Benutzer Kontrolle über ihre Daten haben."

Übernehmen Sie die Kontrolle über Ihre KI-generierten Inhalte

Sie sollten nicht zwischen KI-Nutzung und Schutz Ihrer Privatsphäre wählen müssen. Mit GPT Watermark Remover können Sie:

✅ Unsichtbare Wasserzeichen erkennen in Ihrem ChatGPT-Text ✅ Tracking-Marker entfernen mit einem Klick ✅ Lokal verarbeiten — keine Daten an Server gesendet ✅ Dokumente bereinigen (.docx und .pages Dateien unterstützt) ✅ Ihre Inhalte besitzen ohne Unternehmensüberwachung

Kostenlos für bis zu 500 Zeichen. Keine Registrierung erforderlich.

🔒 Bereinigen Sie Ihren Text privat →

Verwandte Artikel:

- Was sind GPT-Wasserzeichen?

- Wie man ChatGPT-Wasserzeichen entfernt

- Die Wahrheit über ChatGPT-Wasserzeichen

Zuletzt aktualisiert: 16. Januar 2025

Haftungsausschluss: Dieser Artikel repräsentiert redaktionelle Meinung und Analyse. Konsultieren Sie Rechtsexperten für spezifische Rechtsberatung. Wir setzen uns für ethische KI-Nutzung und Benutzerdatenschutzrechte ein.

Verwandte Wissensartikel

Was sind KI-Wasserzeichen? (Text-Wasserzeichen erklärt)

KI-Wasserzeichen sind unsichtbare Markierungen, die in von großen Sprachmodellen (LLMs) generierten Text eingebettet werden. Ihr Zweck besteht darin, zu erkennen, ob ein Text von einer KI erzeugt wurde oder ob er von einem Menschen stammt.

Token-Verteilung beim KI-Wasserzeichen: Warum es für die Erkennung wichtig ist

Die Token-Verteilung beim KI-Wasserzeichen bezieht sich auf die absichtliche Manipulation von Token-Wahrscheinlichkeitsmustern innerhalb von LLM-generiertem Text, um ein verstecktes, statistisch erkennbares Signal einzubetten.

Bereit, KI-Wasserzeichen zu entfernen?

Probieren Sie unser kostenloses KI-Wasserzeichen-Entfernungstool aus. Erkennen und bereinigen Sie unsichtbare Zeichen aus Ihrem Text und Dokumenten in Sekunden.

GPT-Wasserzeichen-Entferner testenEmpfohlene Artikel

Wie funktioniert ein KI-Detektor? Der komplette Leitfaden

Erfahren Sie, wie KI-Detektoren arbeiten: linguistische Analyse (Perplexität & Burstiness) und Wasserzeichen-Erkennung. Warum Detektoren versagen und was Sie tun können.

Sora AI Wasserzeichen: Was es ist und wie man es entfernt

Alles über Sora AI Wasserzeichen: Wie OpenAIs Videogenerator Inhalte markiert, warum das wichtig ist und wie Sie Sora Wasserzeichen zuverlässig entfernen.

Was sind GPT-Wasserzeichen und warum sind sie in KI-Texten versteckt

Entdecken Sie die Wahrheit über GPT-Wasserzeichen: was sie sind, warum KI-Unternehmen sie verwenden und wie diese unsichtbaren Markierungen Ihre Inhalte beeinflussen. Vollständiger Leitfaden mit technischen Erklärungen.